KI hat die Angriffsfläche erweitert: Warum eine vollständige Sicherheitszertifizierung jetzt wichtig ist

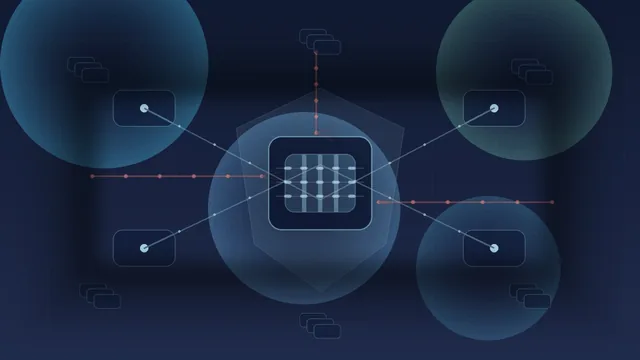

Ein aktuelles Sicherheitsbriefing zum KI-gesteuerten Wachstum der Angriffsfläche, zur vollständigen Überprüfung der Sicherheitskonturen, Agentenrisiken, Behebungsnachweisen und der SToFU-Sicherheitszertifizierung.