AI heeft het aanvalsoppervlak vergroot: waarom volledige beveiligingscertificering nu belangrijk is

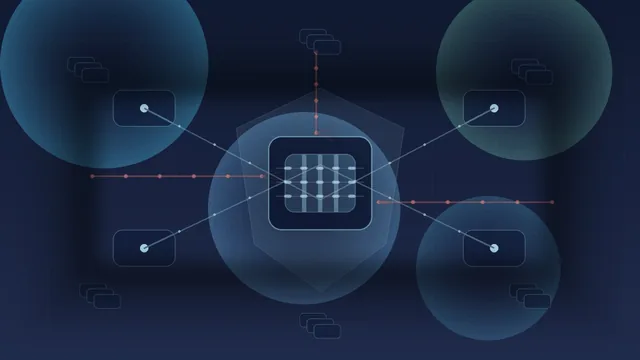

Een actuele beveiligingsbriefing over de door AI aangestuurde groei van het aanvalsoppervlak, volledige beoordeling van de beveiligingscontouren, agentrisico's, herstelbewijs en SToFU beveiligingscertificering.