AI Red Teaming per copiloti e agenti a contatto con i clienti: cosa testare prima che il prodotto raggiunga il pubblico

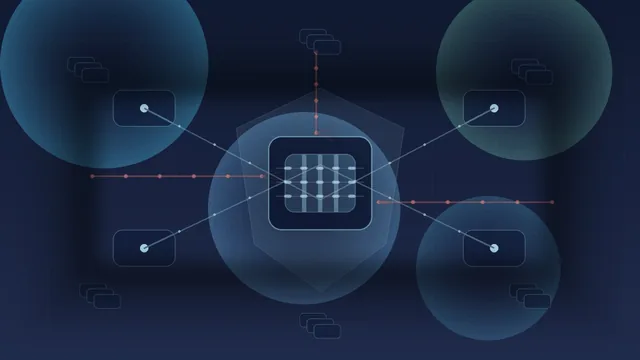

Una guida tecnica per il team rosso di copiloti e agenti a contatto con i clienti. Copre l'abuso immediato, l'abuso degli strumenti, i casi di guasto e i test importanti prima del lancio.